Обучение искусственного интеллекта должно быть направлено на усвоение целей и задач которые необходимы людям.

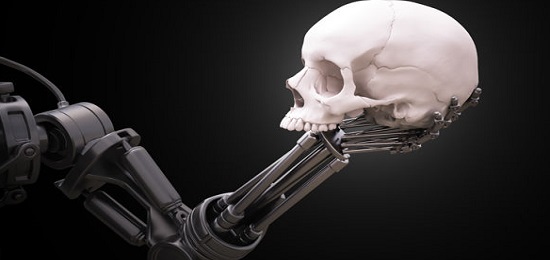

Роботы должны обучиться не тому, что делают люди, а почему они это делают. Эта задача может быть легкой для людей, но это сложная задача для искусственного интеллекта (ИИ).

Кроме того, ИИ может неправильно понять людей.

Это было бы похоже на древнегреческую легенду о царе Мидасе, который просил, чтобы все, к чему он прикасался, превращалось в золото. И наоборот, он был разочарован, когда это благо помешало ему есть и пить. Вышеприведенный пример показывает, что словами говорящего невозможно понять, чего он на самом деле хочет. Но тогда не было известно что такое Искусственный Интеллект.

«Узнать», чего хотят люди, можно, только наблюдая за их целенаправленным поведением.

Обучение искусственного интеллекта в настоящее время сводится к попытке дать машинам возможность выводить цели из поведения. Например, ребенок может по достоинству оценить заботливого робота, который по поведению ребенка может определить правильное время для того, чтобы накормить его.

Таким образом, обучение искусственного интеллекта должно заключаться в способности наблюдения за поведением человека.

Искусственный интеллект должен понять результат

Ключевая идея, лежащая в основе подхода к обучению заключается в том, что решения людей все время раскрывают что-то о конечном результате. Поэтому подход предлагает, наблюдая за решением множества людей в разных ситуациях, ИИ может принимать разные решения и выбирая наиболее правильное для получения результата.

Некоторые спорят о том, что у людей нет стабильных целей, потому что часто они резко меняют свои решения, когда узнают что-то новое и растут выше.

Как заставить машины учиться

Как заставить машины учиться, принимать и сохранять человеческие цели. Однако о чьей цели идет речь? Мы говорим о целях одного человека или группы? Потому что есть огромная разница между целями Адольфа Гитлера, Папы Франциска и президента Путина. Объяснить предмет выбора целей можно описать в трёх законах робототехники:

- Робот не может причинить вред человеку или своим бездействием позволить человеку вооружиться.

- Робот должен подчиняться целям и приказам, данным ему людьми, за исключением тех случаев, когда такие приказы противоречат Первому Закону.

- Робот должен защищать свое существование до тех пор, пока такое производство не противоречит первому и Второму Законам.

Реализация трех законов в области робототехники ставит человека на более безопасную сторону, и человеческая жизнь всегда будет высшей целью для ИИ. Поэтому согласование целей ИИ с целями человека считается этическим выбором.

Пока роботы не могут расставить приоритеты

Многие новые приложения и автономные роботы создаются для человеческой среды, чтобы помочь людям в качестве способных помощников или работать вместе с людьми в качестве кооперативных членов человеко-робототехнических команд. Влияние искусственного интеллекта на людей уже сейчас достаточное.

Например, гуманоидные роботы разрабатываются для оказания людям помощи в их доме, и таким же образом Google «Ассистент» и Яндекс «Алиса» являются лучшей помощью для людей, которые помогают в интернете. В будущем появится больше возможностей для создания роботов, которые разделяют окружающую среду и участвуют в повседневной деятельности людей.

В общем, все понимают, что роботы относятся к нам либо как к другим объектам окружающей среды, либо в лучшем случае взаимодействуют с нами так, как они запрограммированы.

Роботы на самом деле не знают о наших целях и намерениях. В результате они даже не знают, как должным образом скорректировать свое поведение, чтобы помочь нам в изменении наших целей и потребностей. Они, как правило, не привлекают гибкого внимания к тому, что мы сейчас находим интересным, чтобы их поведение можно скоординировать, а информацию сфокусировать на одном и том же.

Они не осознают, что восприятие той или иной ситуации с разных точек зрения влияет на то, что мы знаем и считаем правдой. Следовательно, они не доводят до нашего сведения важную информацию, к которой нам нелегко получить доступ, когда мы в ней нуждаемся.

Они не осознают глубоко наши эмоции, чувства или отношения. В результате они не могут расставить приоритеты в том, что для нас важнее всего, в зависимости от того, что нам нравится или что мы считаем наиболее срочным, актуальным или значительным.

Обучение искусственного интеллекта в области психологии пока на начальном этапе

Ученые в области психологии секса и отношений провели обширное исследование в области «секс-технологий», чтобы сказать, что роботы могут быть нашими партнерами по жизни. Сексуальные отношения с роботами могут показаться сейчас далекими, но они наступают раньше, чем мы думаем. Роботизированный секс может показаться странным сейчас, но наши нынешние социальные нормы о сексе, такие как гей, лесбиянка, должно быть, также казались неестественными людям сто лет назад.

Поэтому по мере развития виртуальной реальности партнер-робот будет становиться все более и более правдоподобным, возможно, даже предпочтительным для человека. Если это становится вероятным и предпочтительным, это поставит под угрозу роль мужа и жены в семье? Если человек женится на ИИ, это будет этическая угроза.

Если нет продолжения рода, это будет означать космологическую угрозу для людей.